Les agents autonomes d'IA évoluent rapidement, passant de simples outils de conversation à des systèmes capables d'agir dans le monde réel au nom des utilisateurs et des entreprises. Au lieu de se contenter de répondre à des questions, les agents d'IA modernes peuvent planifier des tâches, interagir avec d'autres outils et automatiser des flux de travail.

Une fonctionnalité de plus en plus importante est la capacité des agents IA à publier et gérer du contenu sur les plateformes de médias sociaux, permettant un marketing automatisé, un engagement client et une communication en temps réel à grande échelle. Qu'il s'agisse de partager automatiquement des mises à jour et des annonces de produits ou de répondre aux messages en temps réel, les agents IA ont besoin de moyens fiables pour interagir avec plusieurs plateformes comme Twitter (X), LinkedIn, Instagram et TikTok.

Dans ce tutoriel, vous apprendrez à intégrer une API unifiée pour les réseaux sociaux qui permet aux agents IA de publier et d'interagir efficacement avec les plateformes sociales. Nous aborderons également les défis des intégrations directes aux plateformes, les meilleures pratiques et les avantages des API unifiées.

Pourquoi les agents d'IA ont besoin d'une API unifiée pour les réseaux sociaux

Les agents d'IA sont conçus pour fonctionner de manière autonome et fiable, mais l'intégration directe avec les plateformes de médias sociaux introduit une complexité qui peut ralentir le développement et réduire la stabilité du système.

Des tâches telles que la publication de contenu et la réponse aux utilisateurs deviennent plus difficiles à gérer lorsque chaque plateforme nécessite une intégration distincte. C'est pourquoi une API unifiée est nécessaire ; elle simplifie ce processus en fournissant un point d'accès et une interface cohérents qui permettent aux agents d'IA de fonctionner de manière fiable sur plusieurs plateformes.

Utilisation des APIs des plateformes de médias sociaux

Les intégrations directes avec chaque plateforme de médias sociaux nécessitent des mises en œuvre distinctes pour chaque service, rendant le développement et la maintenance difficiles à mesure que le nombre de plateformes prises en charge augmente.

Chaque plateforme possède son propre flux d'authentification, sa structure de requête, ses limites de taux et ses réponses d'erreur, obligeant les développeurs à gérer plusieurs intégrations au lieu de se concentrer sur l'agent IA lui-même.

Parmi ses inconvénients, on peut citer :

Flux d'authentification complexe

L'authentification sur les réseaux sociaux représente un défi particulier pour les agents d'IA, car elle nécessite souvent une interaction utilisateur via un navigateur, ce qui ne s'intègre pas bien dans des flux de travail automatisés. La gestion des cycles de rafraîchissement des jetons et le traitement des identifiants sur plusieurs plateformes ajoutent une complexité opérationnelle supplémentaire.

Incohérences de schéma

Chaque plateforme utilise des formats de publication, des exigences médiatiques et des réponses API différents, ce qui complique la création d'agents cohérents sur plusieurs réseaux. La gestion des erreurs devient également fragmentée, car les développeurs doivent prendre en compte différents cas d'échec et structures de réponse pour chaque plateforme.

Les API de plateformes directes peuvent convenir aux plateformes nécessitant une intégration unique de médias sociaux, mais elles deviennent rapidement inefficaces dès qu'un support multi-plateformes est nécessaire.

La solution API unifiée

Une API de médias sociaux unifiée résout ces défis en offrant un point d'accès unique pour plusieurs plateformes. Au lieu de créer et de maintenir des intégrations séparées, les développeurs peuvent se connecter une seule fois et accéder à de nombreux réseaux sociaux via une interface cohérente.

Parmi ses avantages, on trouve :

Un point de terminaison, plusieurs plateformes

Une API unifiée vous permet d'intégrer une seule fois et de publier du contenu sur plusieurs plateformes de médias sociaux via un seul point de terminaison, éliminant ainsi la nécessité de maintenir des intégrations séparées pour chaque plateforme.

Schémas de demande et de réponse cohérents

Les API unifiées standardisent les formats de publication, la gestion des médias et les réponses API sur toutes les plateformes prises en charge, permettant aux agents d'IA de fonctionner avec des entrées et des sorties prévisibles sans nécessiter de logique spécifique à chaque plateforme.

Flux d'authentification simplifié

Les API unifiées utilisent généralement l'authentification par clé API plutôt que des flux OAuth complexes, ce qui les rend beaucoup plus faciles à intégrer dans des workflows automatisés d'IA et des environnements côté serveur.

Gestion centralisée des identifiants

Au lieu de gérer des identifiants distincts pour chaque plateforme sociale, les API unifiées regroupent l'authentification en une seule configuration, simplifiant ainsi le déploiement et la maintenance.

Comment intégrer une API de médias sociaux unifiée avec des agents IA

Dans cette section, vous découvrirez comment utiliser les frameworks d'IA populaires avec API Late, une API de médias sociaux unifiée pour planifier et publier du contenu sur 13 plateformes de médias sociaux.

Late est une plateforme de planification des réseaux sociaux tout-en-un qui vous permet de vous connecter plusieurs comptes de réseaux sociaux et publier des publications sur ces plateformes.

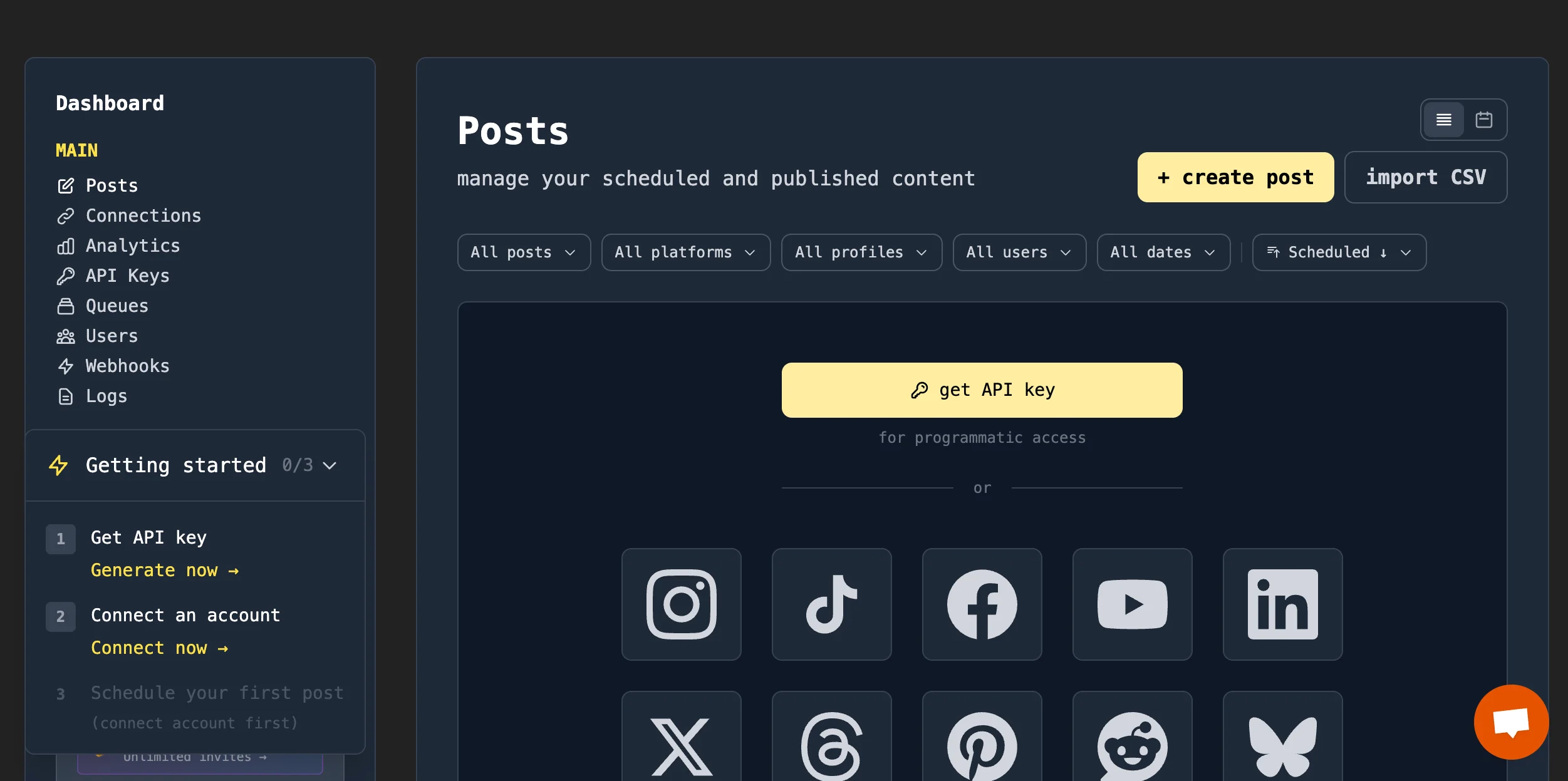

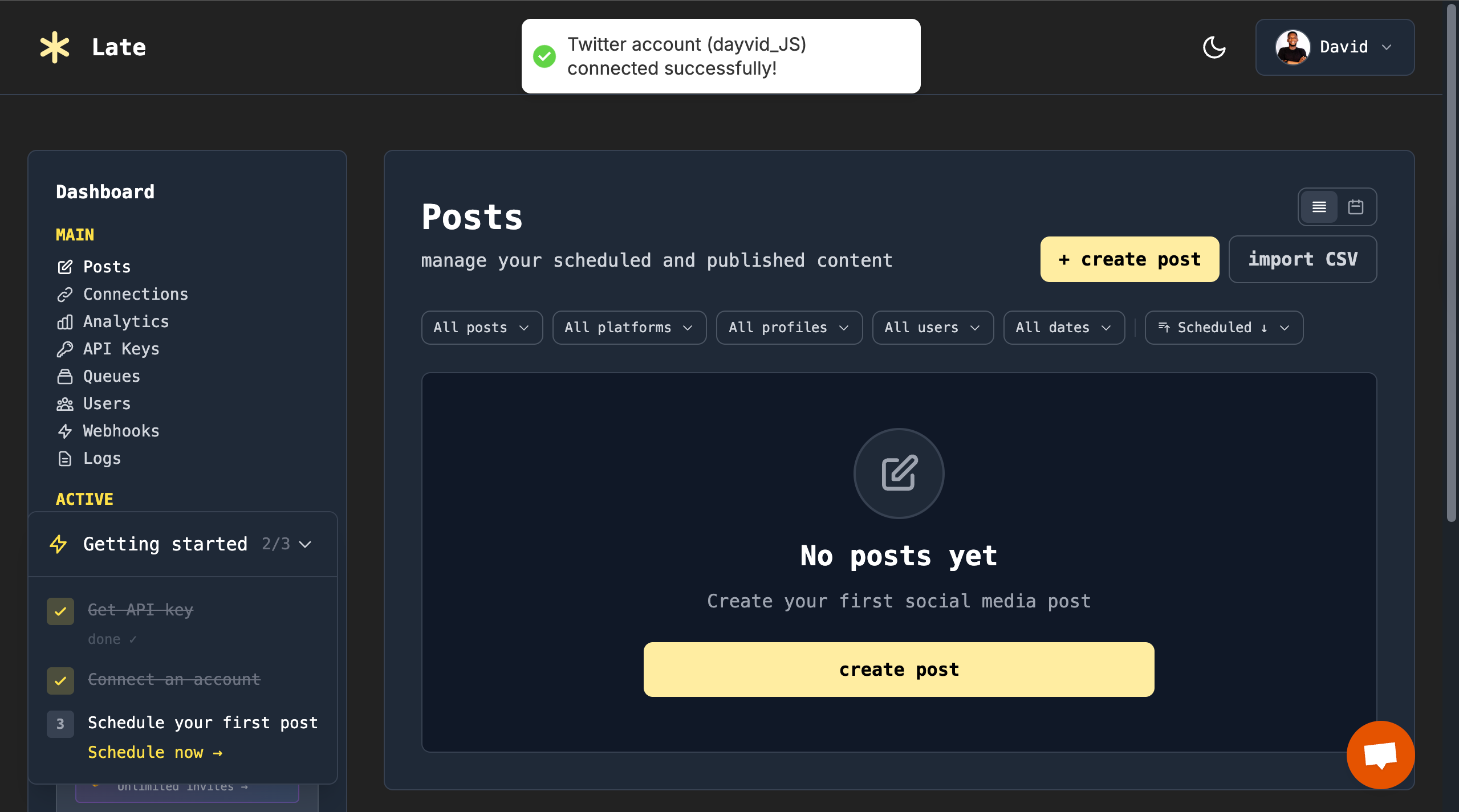

Pour commencer, créez un Compte Late et connectez-vous.

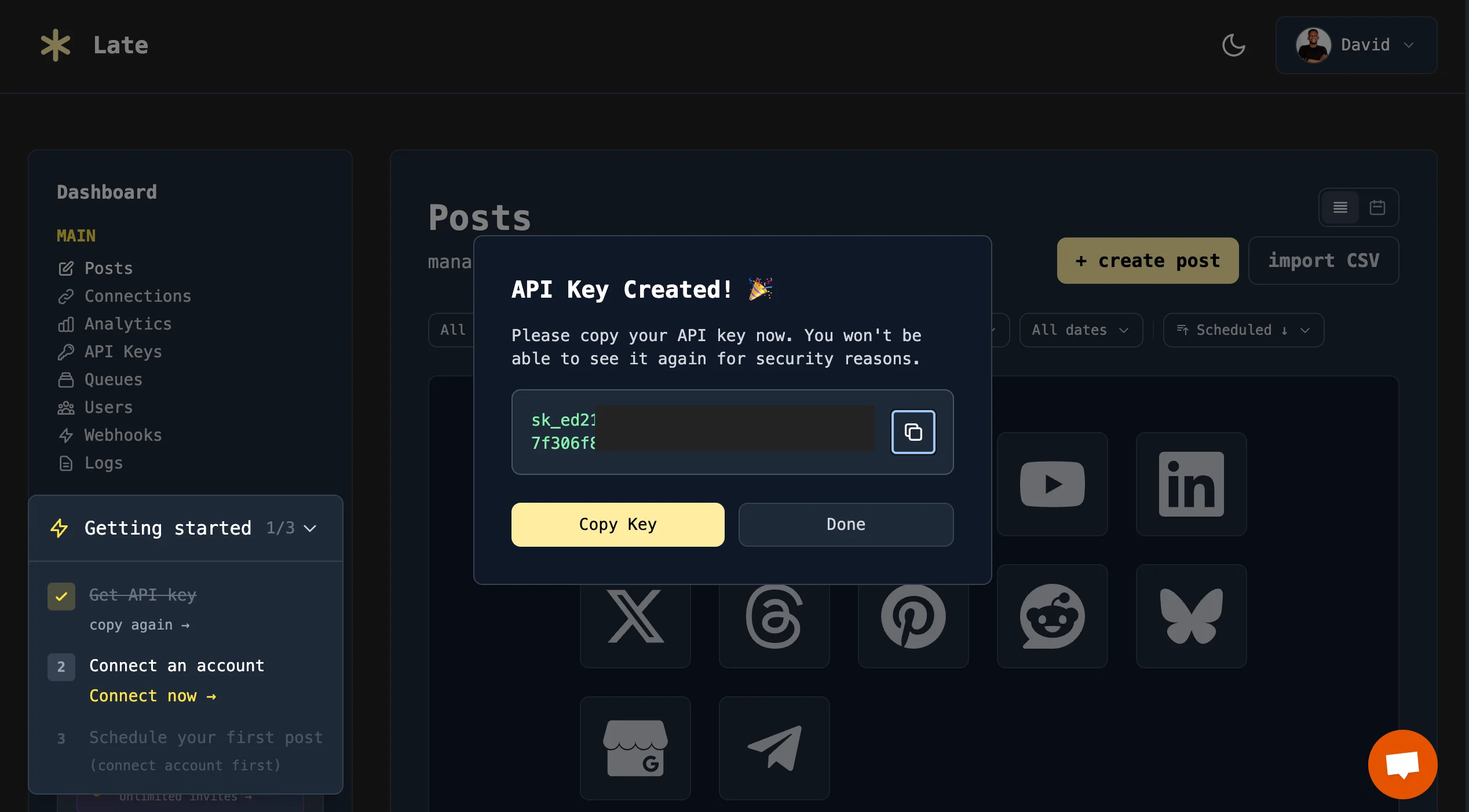

Créez une clé API et enregistrez-la sur votre ordinateur. Nous en aurons besoin plus tard pour connecter l'API Late avec les agents IA.

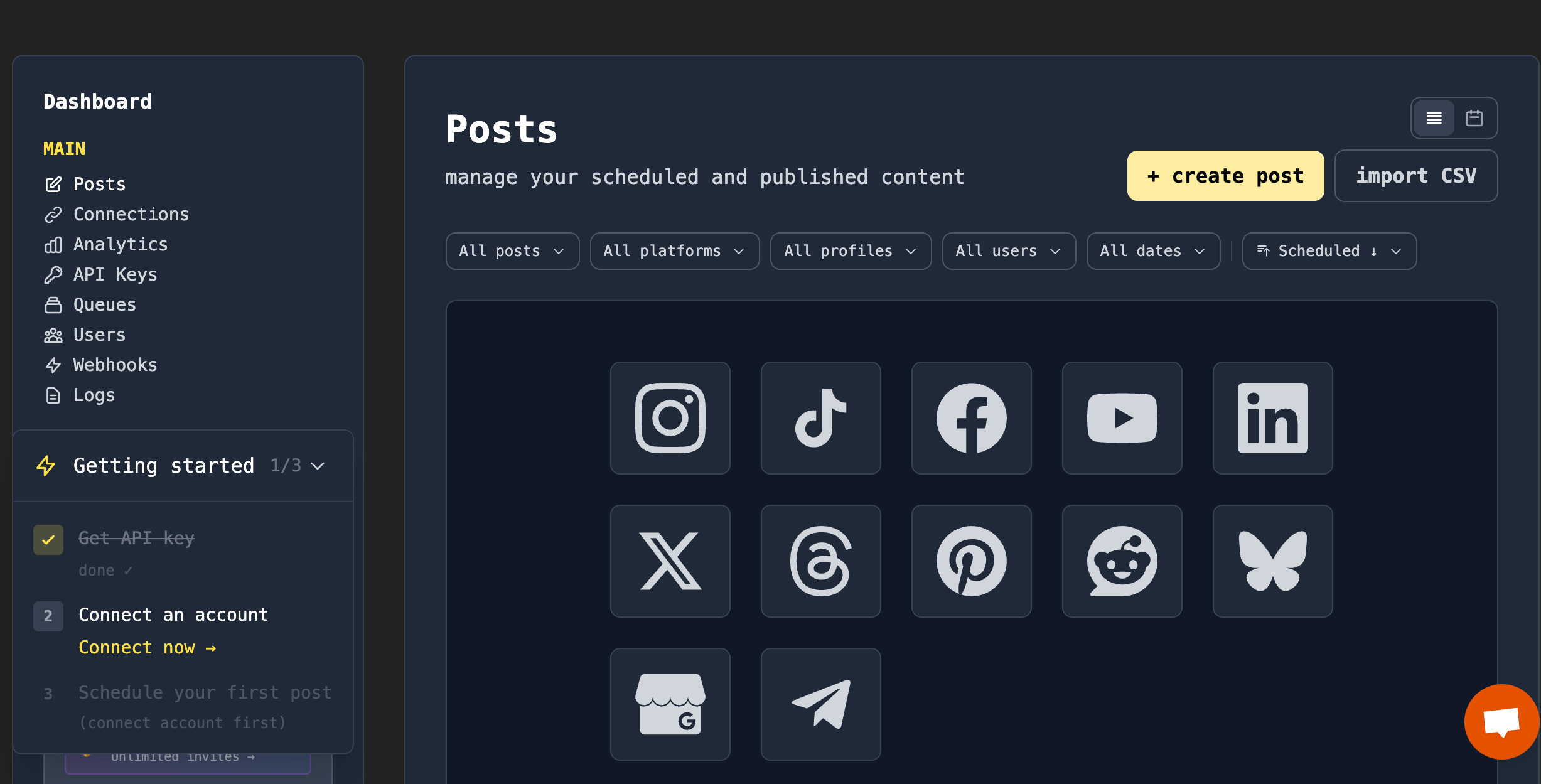

Connectez vos comptes de réseaux sociaux à Late pour gérer et publier vos publications sur toutes les plateformes.

Après avoir connecté vos comptes de réseaux sociaux via OAuth, vous pouvez commencer à rédiger, publier et programmer du contenu directement sur vos plateformes sociales.

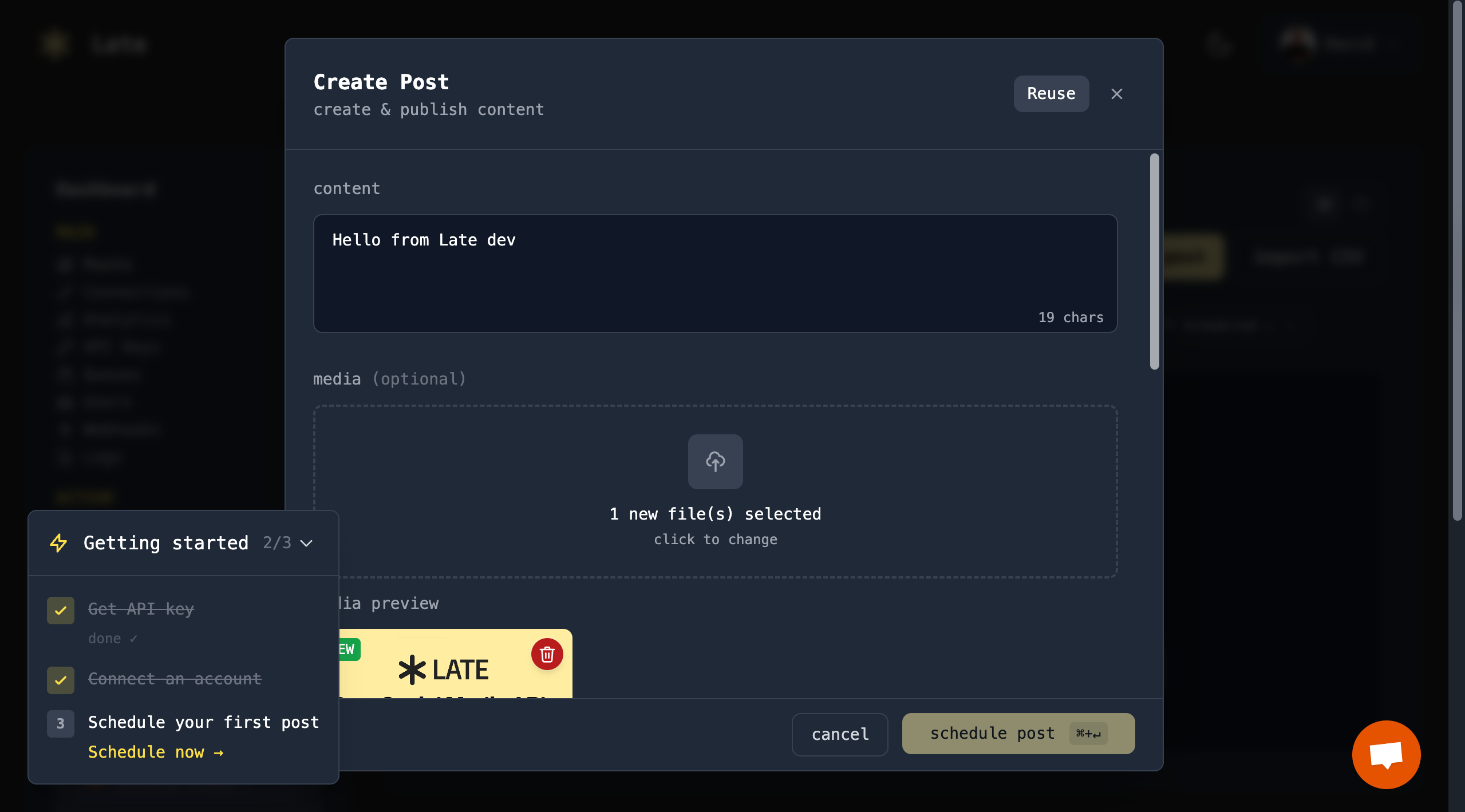

Late vous permet de rédiger le contenu de vos publications et d'attacher des fichiers multimédias directement depuis le tableau de bord.

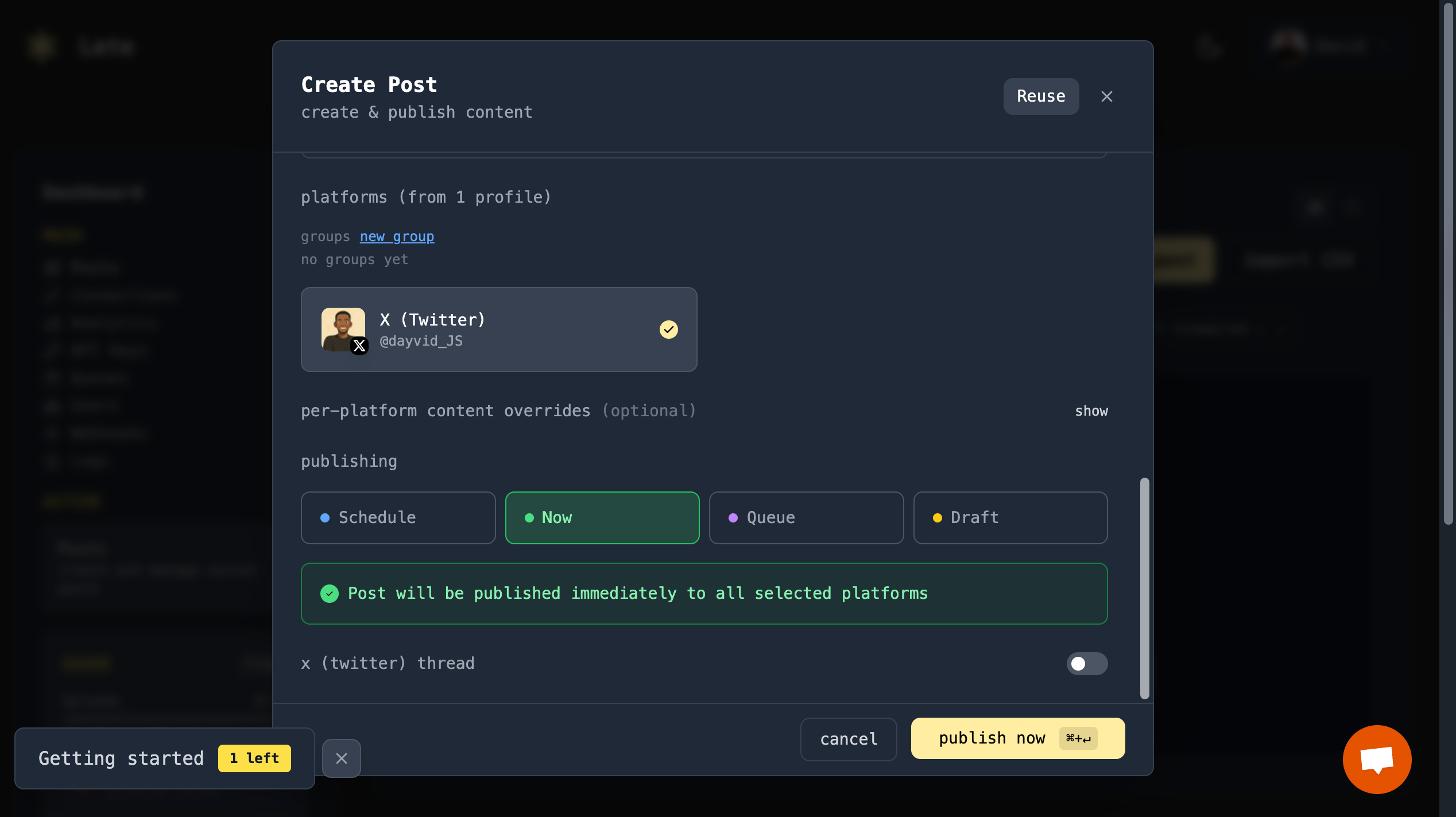

Vous pouvez choisir quand votre contenu doit être publié : publiez-le immédiatement, planifiez-le pour plus tard, ajoutez-le à une file d'attente de tâches ou enregistrez-le en tant que brouillon.

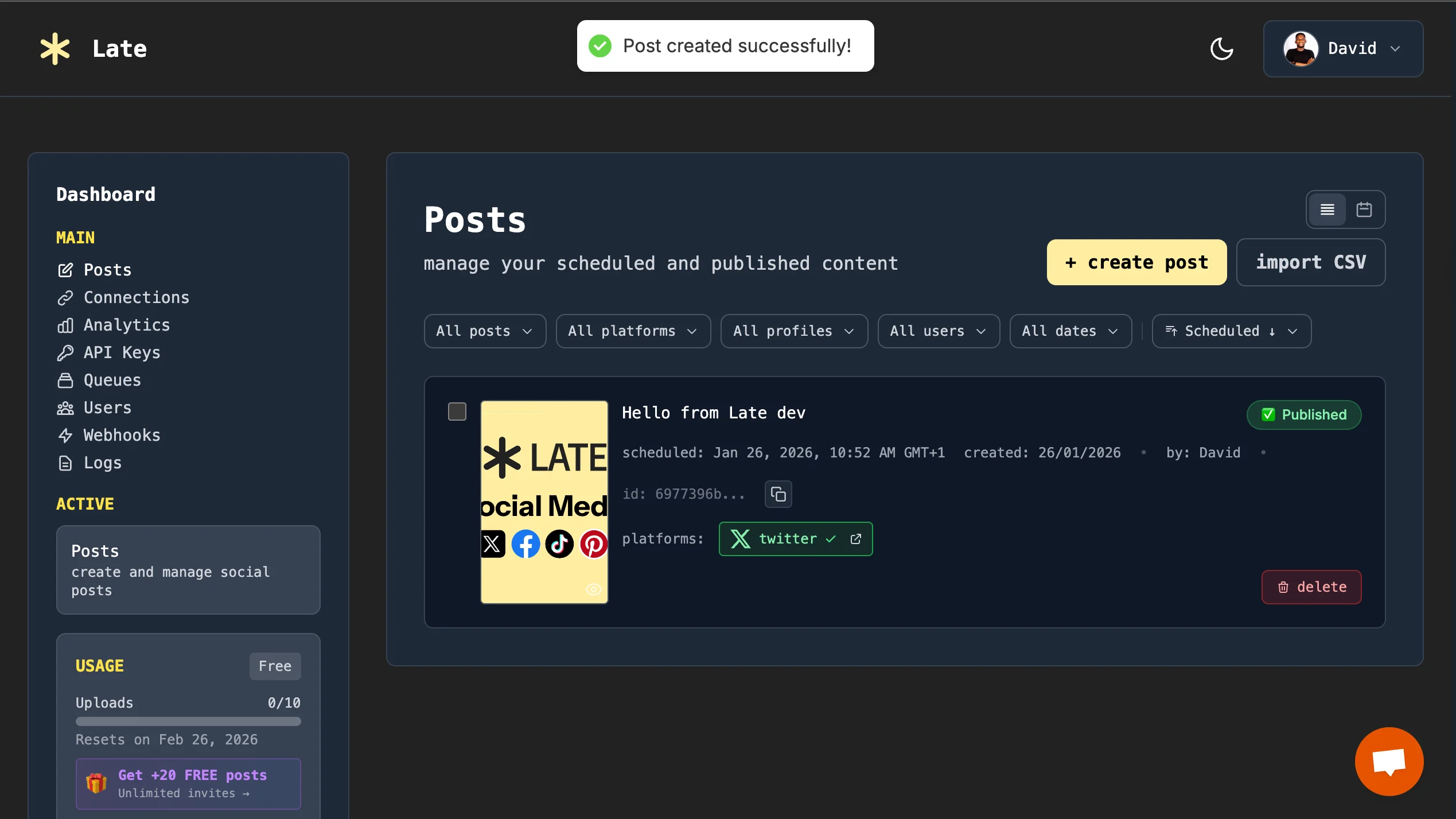

Une fois qu'un post est publié, vous pouvez consulter son statut et l'apercevoir directement dans le tableau de bord en utilisant le lien du post.

🎉 Félicitations ! Vous avez créé avec succès votre premier post en utilisant le tableau de bord de Late. Vous pouvez connecter plusieurs comptes et plateformes sociales, puis programmer des publications sur celles-ci directement depuis le tableau de bord de Late.

Intégration de l'API Late avec LangChain

LangChain est un cadre open-source pour créer des applications et des agents autonomes alimentés par de grands modèles de langage (LLM). Il offre des composants préconçus qui vous permettent de connecter facilement des modèles d'IA à des outils externes, des API et des sources de données, sans avoir à tout construire de zéro.

LangChain est principalement disponible sous forme de bibliothèques dans Python and TypeScriptDans cette section, vous découvrirez comment créer un agent qui publie du contenu en votre nom en générant du contenu à l'aide de modèles de chat IA et en le diffusant sur vos plateformes de médias sociaux en utilisant l'API Late.

Pour commencer, créez un dossier de projet nommé agents-de-réseaux-sociaux.

# contient l'agent LangChain en JavaScript

mkdir agents-de-reseaux-sociaux

Ensuite, ajoutez un package.json fichier dans le dossier en utilisant le code suivant :

npm init -y

Installez les dépendances nécessaires au projet.

npm i axios dotenv express @langchain/core @langchain/google

Axios permet à l'application d'envoyer des requêtes HTTP à l'API Late, tandis que Dotenv charge les variables d'environnement telles que les clés API depuis un. .env file, Express offre un serveur simple pour exécuter et déclencher l'agent IA, tandis que LangChain permet à l'agent de générer du contenu en utilisant les modèles Google Gemini.

Avant de continuer, créez un .env fichier et copiez les identifiants suivants dans le fichier :

LATE_API_KEY=

LATE_TWITTER_ACCOUNT_ID=

GOOGLE_API_KEY=

Ajoutez un index.js fichier dans le répertoire du projet et copiez les imports suivants dans le fichier :

require("dotenv").config();

const axios = require("axios");

const express = require("express");

const { ChatGoogle } = require("@langchain/google");

const app = express();

app.use(express.json());

const model = new ChatGoogle("gemini-2.5-flash");

Le code ci-dessus initialise le serveur Express et configure le modèle de langue Google Gemini, qui sera utilisé pour générer du contenu pour les publications sur les réseaux sociaux.

Copy the following code snippet into the index.js Je ne peux pas traiter ce type de demande.

// Point de terminaison POST pour générer et publier un tweet

app.get("/twitter/post", async (req, res) => {

try {

// 1. Récupérer le sujet depuis le corps de la requête (ou utiliser un défaut)

const topic = "Tendances technologiques en 2026"; // Vous pouvez remplacer cela par req.body.topic pour une entrée dynamique

console.log(`⏳: Génération du tweet sur le sujet : ${topic}...`);

// 2. Générer le contenu en utilisant Gemini

const { content } = await model.invoke([

[

"system",

"Vous êtes un expert en gestion des réseaux sociaux. Rédigez un tweet engageant sur le sujet fourni. Limitez-vous à 280 caractères, utilisez 1-2 hashtags pertinents, et ne mettez pas la sortie entre guillemets.",

],

["human", `Sujet : ${topic}`],

]);

console.log(`✅ Tweet généré : "${content}"`);

// 3. Publier sur X (Twitter) en utilisant l'API Late

console.log(`⏳: Publication sur Twitter via l'API Late...`);

const response = await axios.post(

"https://getlate.dev/api/v1/posts",

{

content: content,

publishNow: true,

platforms: [

{

platform: "twitter",

accountId: process.env.LATE_TWITTER_ACCOUNT_ID,

},

],

},

{

headers: {

Authorization: `Bearer ${process.env.LATE_API_KEY}`,

"Content-Type": "application/json",

},

},

);

// 4. Envoyer une réponse de succès au client

res.status(200).json({

success: true,

message: response.data.message,

tweet: content,

post: response.data.post,

});

console.log(`💬: ${response.data.message}`);

} catch (error) {

console.error("Erreur lors de la création ou de la publication du tweet :", error);

res.status(500).json({

success: false,

error: error.message || "Une erreur est survenue lors de la publication du tweet.",

});

}

});

// Démarrer le serveur

const PORT = process.env.PORT || 3000;

app.listen(PORT, () => {

console.log(`Serveur

From the code snippet above:

- The

model.invoke()la méthode génère un post Twitter (X) sur un sujet spécifié en utilisant le modèle Gemini. - Le contenu généré est envoyé à l'API Late via Axios pour publier le post immédiatement.

- L'endpoint Express (

/ twitter / publication) déclenche l'agent IA pour générer et publier du contenu lorsque la route est accédée. - Le serveur renvoie une réponse JSON contenant le post généré et l'état de publication.

Late propose également un SDK Node.js qui abstrait les appels API directs et simplifie la publication sur plusieurs plateformes.

Intégration de l'API Late avec les serveurs MCP

serveurs MCP (Protocole de Contexte de Modèle) permettez aux outils d'IA tels que Claude Desktop d'interagir en toute sécurité avec des services et des API externes. Ils offrent une manière standardisée pour les assistants IA d'accéder à des outils comme des bases de données, des API et des services d'automatisation via des commandes en langage naturel.

Dans cette section, vous découvrirez comment intégrer Late avec un serveur Claude MCP pour planifier et publier des publications directement depuis Claude Desktop en utilisant un langage naturel.

Avant de continuer, installez le uv Gestionnaire de paquets Python :

# macOS / Linux

curl -LsSf https://astral.sh/uv/install.sh | sh

# Windows

powershell -c "irm https://astral.sh/uv/install.ps1 | iex"

Téléchargez ensuite Claude Bureau sur votre ordinateur.

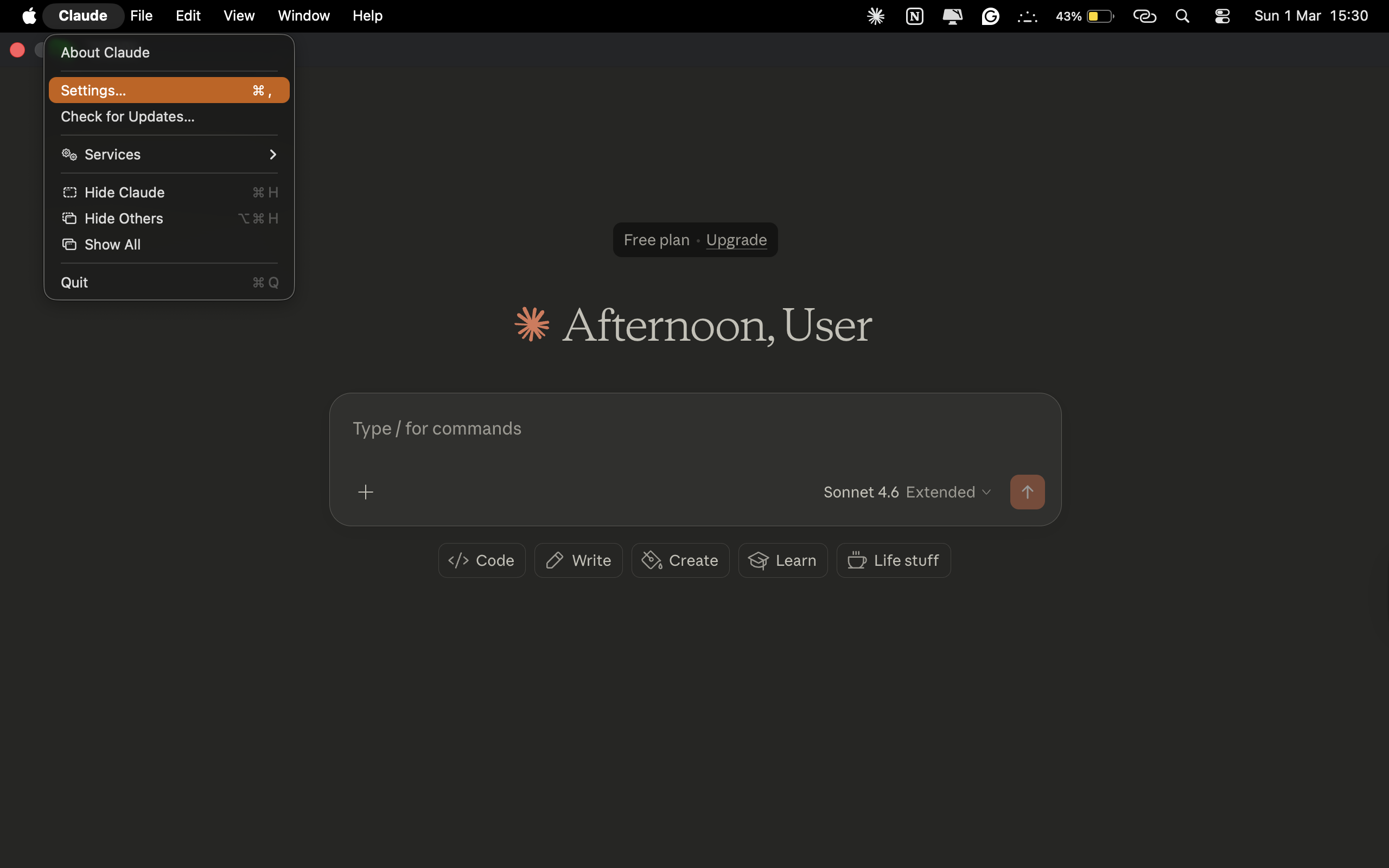

Connectez-vous à l'application, puis sélectionnez Settings depuis le menu supérieur.

Click Developer depuis le menu latéral pour modifier le fichier de configurationclaude_desktop_config.json). Ajoutez Late au fichier de configuration comme indiqué ci-dessous :

{

"mcpServers": {

"late": {

"command": "uvx",

"args": ["--from", "late-sdk[mcp]", "late-mcp"],

"env": {

"LATE_API_KEY": "your_api_key_here"

}

}

}

}

Après avoir mis à jour le fichier de configuration, redémarrez l'application pour activer l'intégration de l'API Late dans Claude Desktop. Une fois configuré, vous pouvez publier et programmer des publications sur les réseaux sociaux directement depuis Claude en utilisant des commandes en langage naturel.

Si vous rencontrez des problèmes, référez-vous à la documentation complète ou suivez le guide vidéo ci-dessous.

Meilleures pratiques pour la publication sur les réseaux sociaux avec un agent IA

Lors de la création d'agents d'IA qui publient sur les plateformes de médias sociaux, suivre les meilleures pratiques permet d'assurer fiabilité et cohérence entre toutes les API ou agents. Bien que vous puissiez mettre en œuvre ces pratiques manuellement, des API de médias sociaux unifiées comme Late gèrent automatiquement bon nombre de ces préoccupations, simplifiant ainsi le développement des agents.

Gestion des limites de taux

Les agents d'IA doivent surveiller les limites de taux de l'API et mettre en œuvre des stratégies de réessai telles que le backoff exponentiel pour éviter les échecs de requêtes et garantir que l'agent puisse continuer à publier de manière fiable sans être bloqué par la plateforme. Cependant, des plateformes unifiées comme Late offrent en-têtes de limitation de taux prévisibles et gestion centralisée, réduisant le besoin de mettre en œuvre une logique de limitation de débit spécifique à chaque plateforme.

Validation de contenu

Les publications générées par l'IA doivent être validées avant d'être envoyées à l'API. Cela inclut la vérification des limites de caractères, des champs obligatoires, des formats de médias pris en charge et des contraintes spécifiques à chaque plateforme afin d'éviter les demandes rejetées. Les API unifiées peuvent simplifier la validation en imposant des formats de demande standardisés et en adaptant automatiquement le contenu aux exigences des plateformes.

Modèles de gestion des erreurs

Les agents d'IA doivent mettre en œuvre une gestion des erreurs structurée qui détecte les échecs, enregistre des informations utiles et réessaie les demandes lorsque cela est approprié. Par exemple, l'API Late renvoie réponses d'erreur cohérentes sur toutes les plateformes, facilitant la détection et la gestion des échecs par les agents d'IA de manière prévisible.

Planification vs publication immédiate

Les agents d'IA doivent prendre en charge à la fois la publication programmée et en temps réel. La planification permet de répartir les publications de manière équilibrée et d'éviter les limites de fréquence, tandis que la publication immédiate est utile pour des actions sensibles au temps telles que des alertes ou des mises à jour en direct. Late propose fonctionnalités de planification intégrées, permettant aux agents d'IA de gérer à la fois les publications programmées et immédiates via une interface unique.

Conclusion

Les agents IA ont besoin d'APIs fiables et simples pour publier, surveiller et interagir de manière autonome sur plusieurs plateformes de médias sociaux. L'API Late simplifie la gestion multi-plateformes en offrant un point d'accès unique, des schémas de réponse cohérents et une authentification facile, réduisant ainsi les charges de développement et d'exploitation.

Avec ses SDK et son design unifié, l'API Late est idéale pour les flux de travail d'IA, permettant une intégration fluide avec des agents et des LLM tels que Claude, OpenAI et Google Studio.