Autonome KI-Agenten entwickeln sich schnell von einfachen Konversationswerkzeugen zu Systemen, die in der Lage sind, im Namen von Nutzern und Unternehmen reale Aktionen durchzuführen. Anstatt nur Fragen zu beantworten, können moderne KI-Agenten Aufgaben planen, mit anderen Tools interagieren und Arbeitsabläufe automatisieren.

Eine zunehmend wichtige Funktion ist die Fähigkeit von KI-Agenten, Inhalte auf sozialen Medien zu veröffentlichen und zu verwalten. Dies ermöglicht automatisiertes Marketing, Kundenengagement und Echtzeitkommunikation in großem Maßstab. Von der automatischen Weitergabe von Updates und Produktankündigungen bis hin zur zeitnahen Beantwortung von Nachrichten benötigen KI-Agenten zuverlässige Möglichkeiten, um mit mehreren Plattformen wie Twitter (X), LinkedIn, Instagram und TikTok zu interagieren.

In diesem Tutorial erfahren Sie, wie Sie eine einheitliche Social-Media-API integrieren, die es KI-Agenten ermöglicht, effizient auf Social-Media-Plattformen zu posten und zu interagieren. Wir werden auch die Herausforderungen direkter Plattformintegrationen, bewährte Methoden und die Vorteile einheitlicher APIs untersuchen.

Warum KI-Agenten eine einheitliche Social Media API benötigen

KI-Agenten sind darauf ausgelegt, autonom und zuverlässig zu arbeiten, aber die direkte Integration mit sozialen Medien bringt Komplexität mit sich, die die Entwicklung verlangsamen und die Systemstabilität verringern kann.

Aufgaben wie das Veröffentlichen von Inhalten und das Beantworten von Nutzern werden schwieriger zu verwalten, wenn jede Plattform eine separate Integration erfordert. Deshalb ist eine einheitliche API notwendig; sie vereinfacht diesen Prozess, indem sie einen konsistenten Endpunkt und eine Schnittstelle bereitstellt, die es KI-Agenten ermöglicht, zuverlässig über mehrere Plattformen hinweg zu agieren.

Verwendung von APIs der sozialen Medien

Direkte Integrationen mit einzelnen sozialen Medien erfordern separate Implementierungen für jeden Dienst, was die Entwicklung und Wartung erschwert, je mehr Plattformen unterstützt werden.

Jede Plattform hat ihren eigenen Authentifizierungsprozess, ihre eigene Anforderungsstruktur, unterschiedliche Ratenlimits und Fehlerantworten, was Entwickler zwingt, mehrere Integrationen zu verwalten, anstatt sich auf den KI-Agenten selbst zu konzentrieren.

Zu den Nachteilen gehören:

Komplexer Authentifizierungsworkflow

Die Authentifizierung in sozialen Medien stellt für KI-Agenten eine besondere Herausforderung dar, da sie häufig eine benutzerbasierte Interaktion im Browser erfordert, was nicht gut mit automatisierten Workflows harmoniert. Die Verwaltung von Token-Aktualisierungszyklen und der Umgang mit Anmeldeinformationen über mehrere Plattformen hinweg erhöhen die betriebliche Komplexität zusätzlich.

Schema-Inkonsistenzen

Jede Plattform verwendet unterschiedliche Postformate, Medienanforderungen und API-Antworten, was es schwierig macht, Agenten zu entwickeln, die über mehrere Netzwerke hinweg konsistent sind. Auch die Fehlerbehandlung wird fragmentiert, da Entwickler verschiedene Fehlerszenarien und Antwortstrukturen für jede Plattform berücksichtigen müssen.

Direkte Plattform-APIs sind möglicherweise für Plattformen geeignet, die eine einzige Social-Media-Integration benötigen, aber sie werden zunehmend ineffizient, sobald Unterstützung für mehrere Plattformen erforderlich ist.

Die einheitliche API-Lösung

Eine einheitliche Social-Media-API löst diese Herausforderungen, indem sie einen einzigen Endpunkt für mehrere Plattformen bereitstellt. Anstatt separate Integrationen zu erstellen und zu pflegen, können Entwickler sich einmal verbinden und über eine konsistente Schnittstelle auf viele soziale Netzwerke zugreifen.

Zu den Vorteilen gehören:

Ein Endpunkt, mehrere Plattformen

Eine einheitliche API ermöglicht es Ihnen, einmal zu integrieren und Inhalte über mehrere Social-Media-Plattformen hinweg über einen einzigen Endpunkt zu veröffentlichen. So entfällt die Notwendigkeit, separate Integrationen für jede Plattform zu pflegen.

Konsistente Anfrage- und Antwortschemata

Einheitliche APIs standardisieren die Postformate, die Medienverarbeitung und die API-Antworten über alle unterstützten Plattformen hinweg. Dadurch können KI-Agenten mit vorhersehbaren Eingaben und Ausgaben arbeiten, ohne plattformspezifische Logik zu benötigen.

Vereinfachter Authentifizierungsworkflow

Einheitliche APIs verwenden in der Regel die Authentifizierung über API-Schlüssel anstelle komplexer OAuth-Workflows, was die Integration in automatisierte KI-Workflows und serverseitige Umgebungen erheblich erleichtert.

Zentralisierte Verwaltung von Anmeldeinformationen

Anstatt separate Anmeldeinformationen für jede Social-Media-Plattform zu verwalten, bündeln einheitliche APIs die Authentifizierung in einer einzigen Konfiguration, was die Bereitstellung und Wartung vereinfacht.

So integrieren Sie eine einheitliche Social Media API mit KI-Agenten

In diesem Abschnitt erfahren Sie, wie Sie gängige KI-Frameworks mit Late API, eine einheitliche Social-Media-API zum Planen und Veröffentlichen von Inhalten auf 13 Social-Media-Plattformen.

Late ist eine All-in-One-Plattform zur Planung von sozialen Medien, die es Ihnen ermöglicht, sich zu verbinden mehrere Social-Media-Konten und Beiträge auf ihnen veröffentlichen.

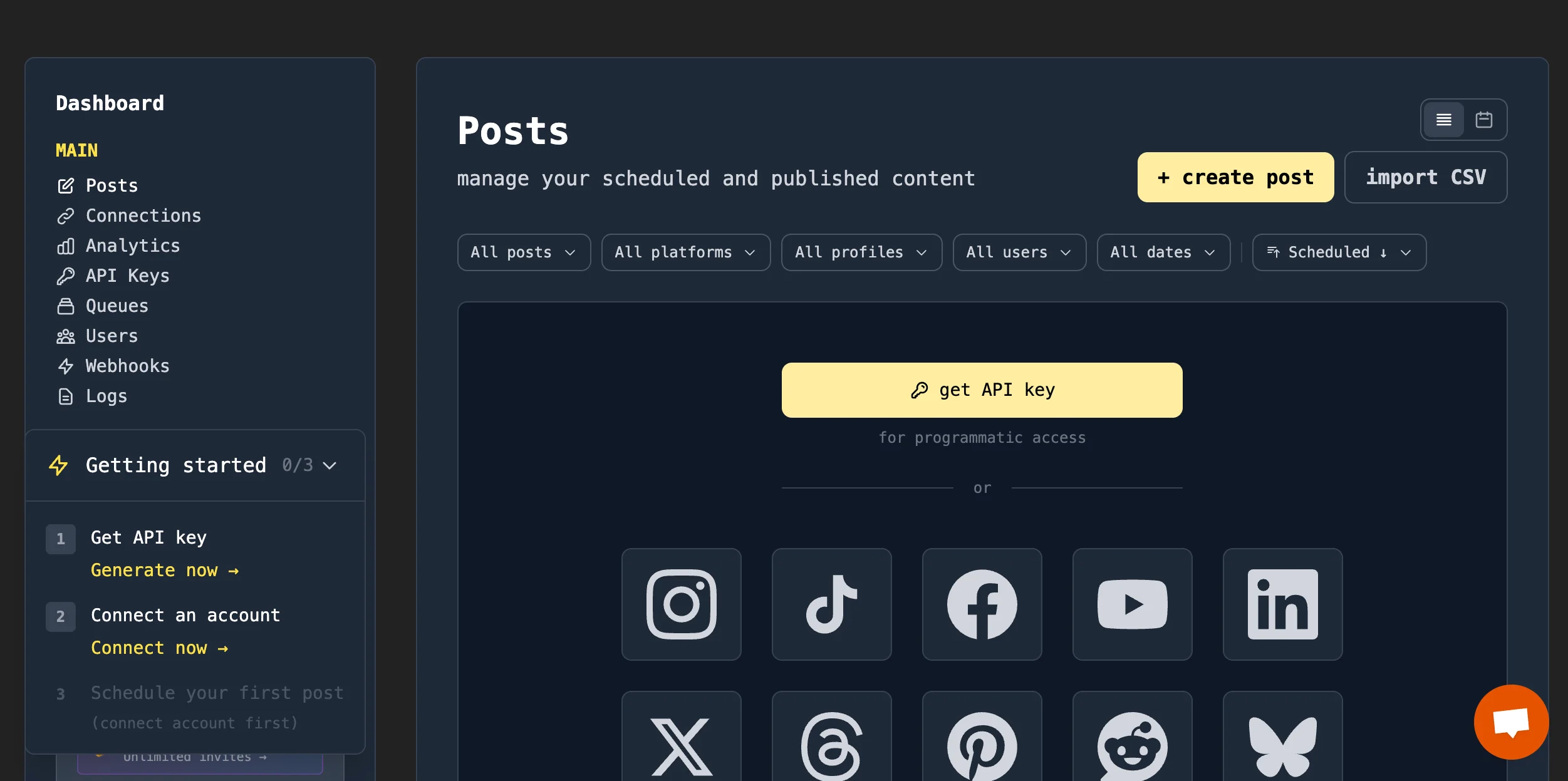

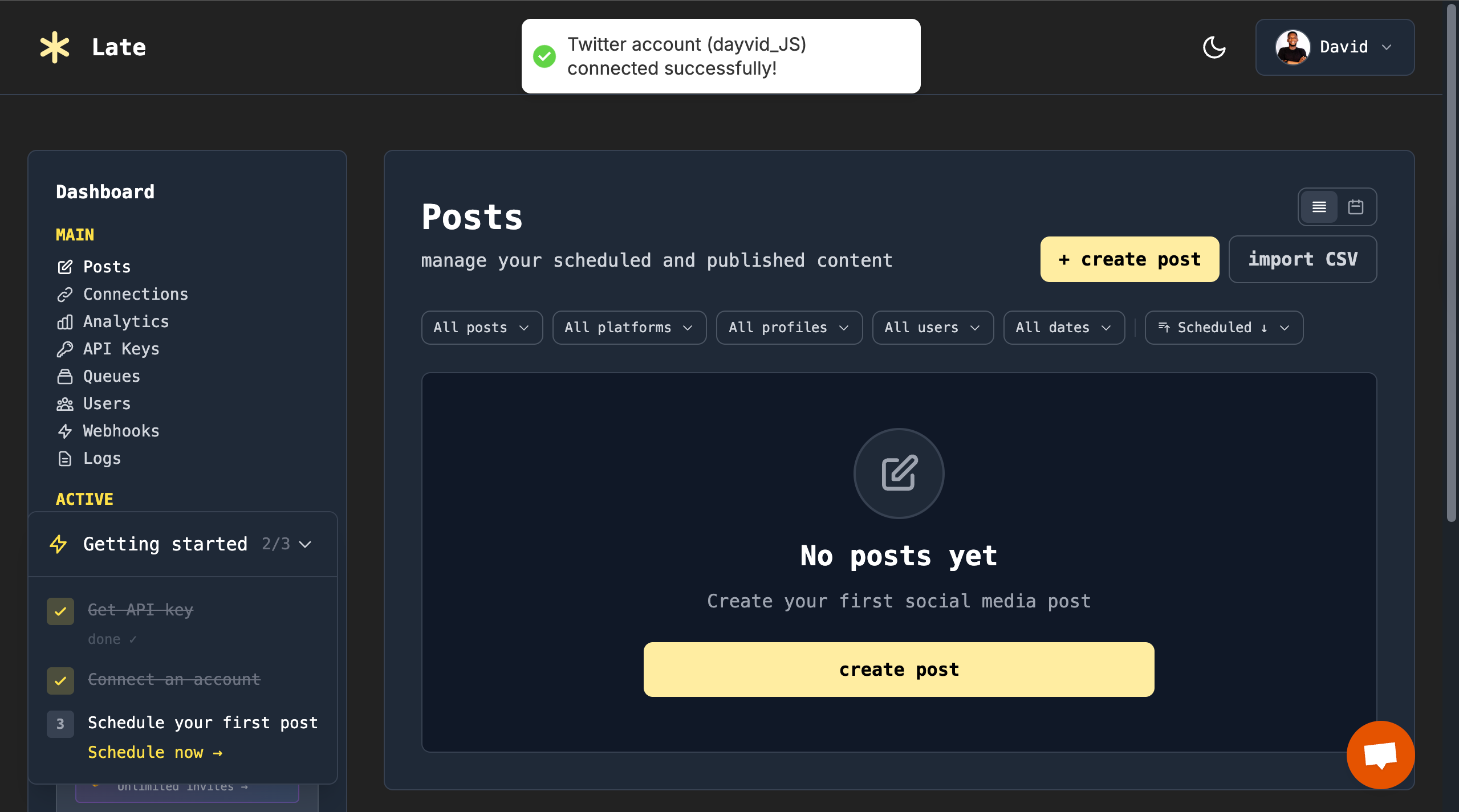

Um loszulegen, erstellen Sie ein Late-Konto und anmelden.

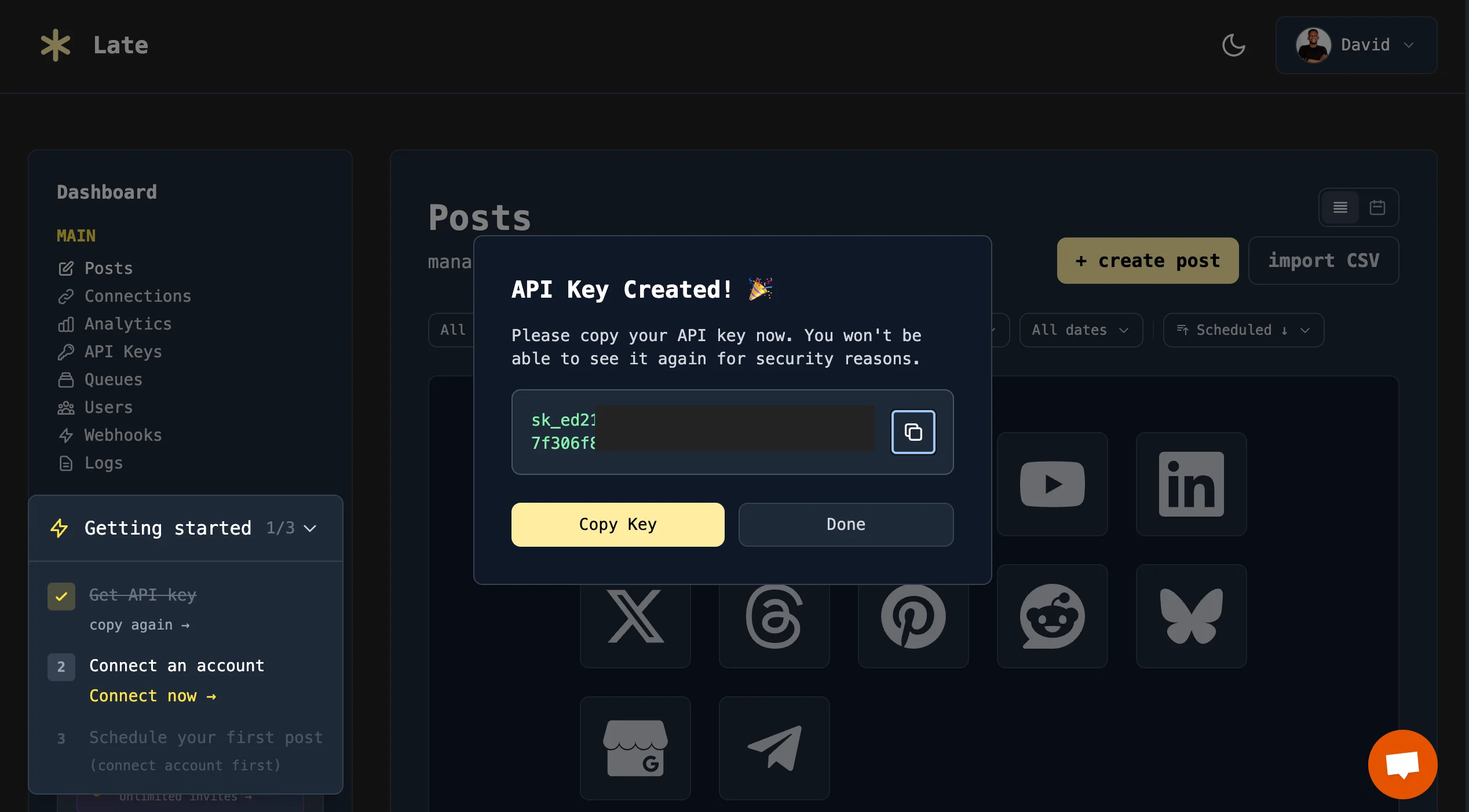

Erstellen Sie einen API-Schlüssel und speichern Sie ihn auf Ihrem Computer. Wir benötigen ihn später, um die Late API mit KI-Agenten zu verbinden.

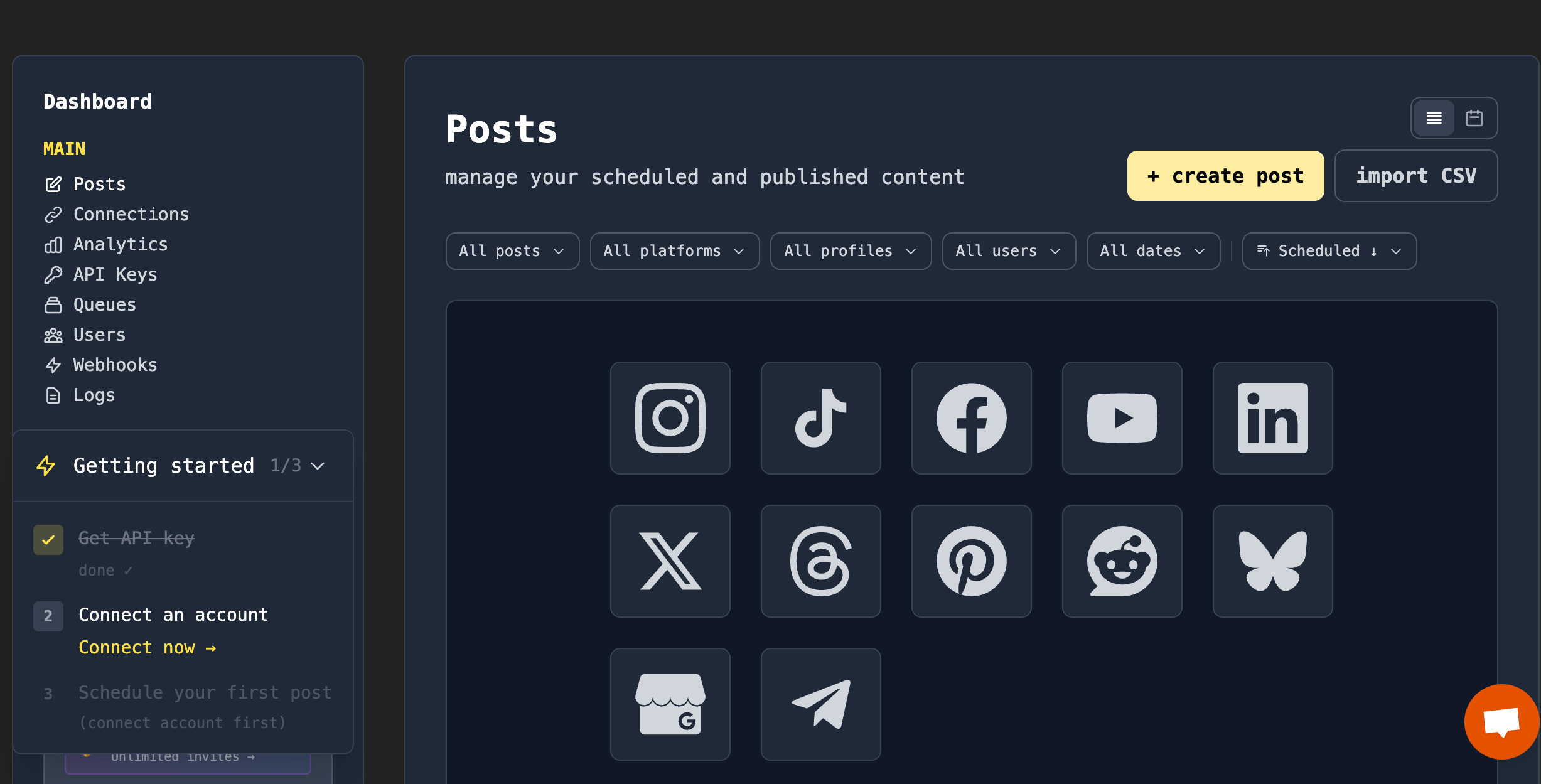

Verbinde deine Social-Media-Konten mit Late, um Beiträge auf allen Plattformen zu verwalten und zu veröffentlichen.

Nachdem Sie Ihre Social-Media-Konten über OAuth verbunden haben, können Sie direkt Inhalte für Ihre Social-Media-Plattformen schreiben, posten und planen.

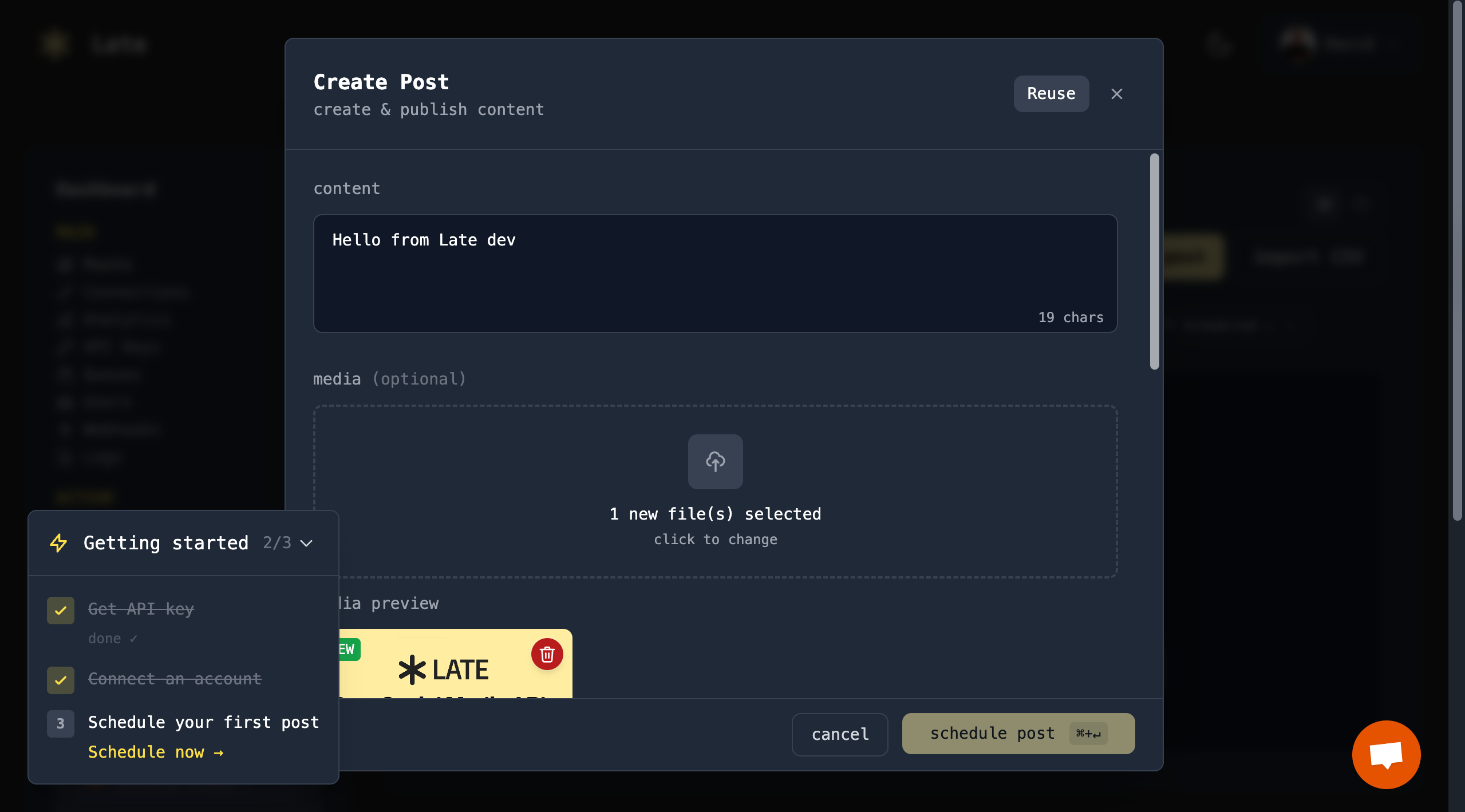

Late ermöglicht es dir, deine Beitragsinhalte zu erstellen und Medienfiles direkt vom Dashboard aus anzuhängen.

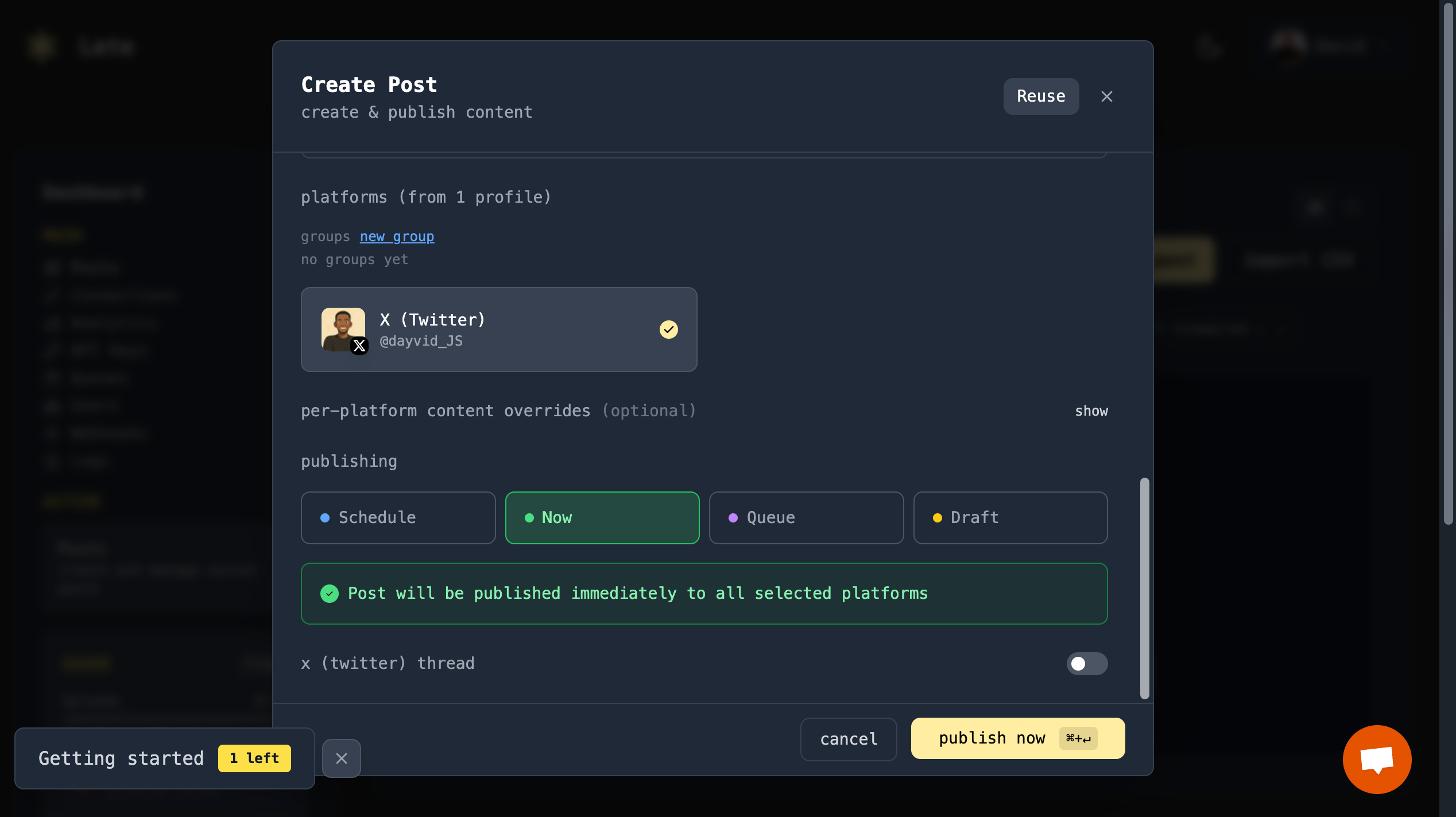

Sie können entscheiden, wann Ihre Inhalte veröffentlicht werden sollen: sofort posten, für später planen, in eine Warteschlange einreihen oder als Entwurf speichern.

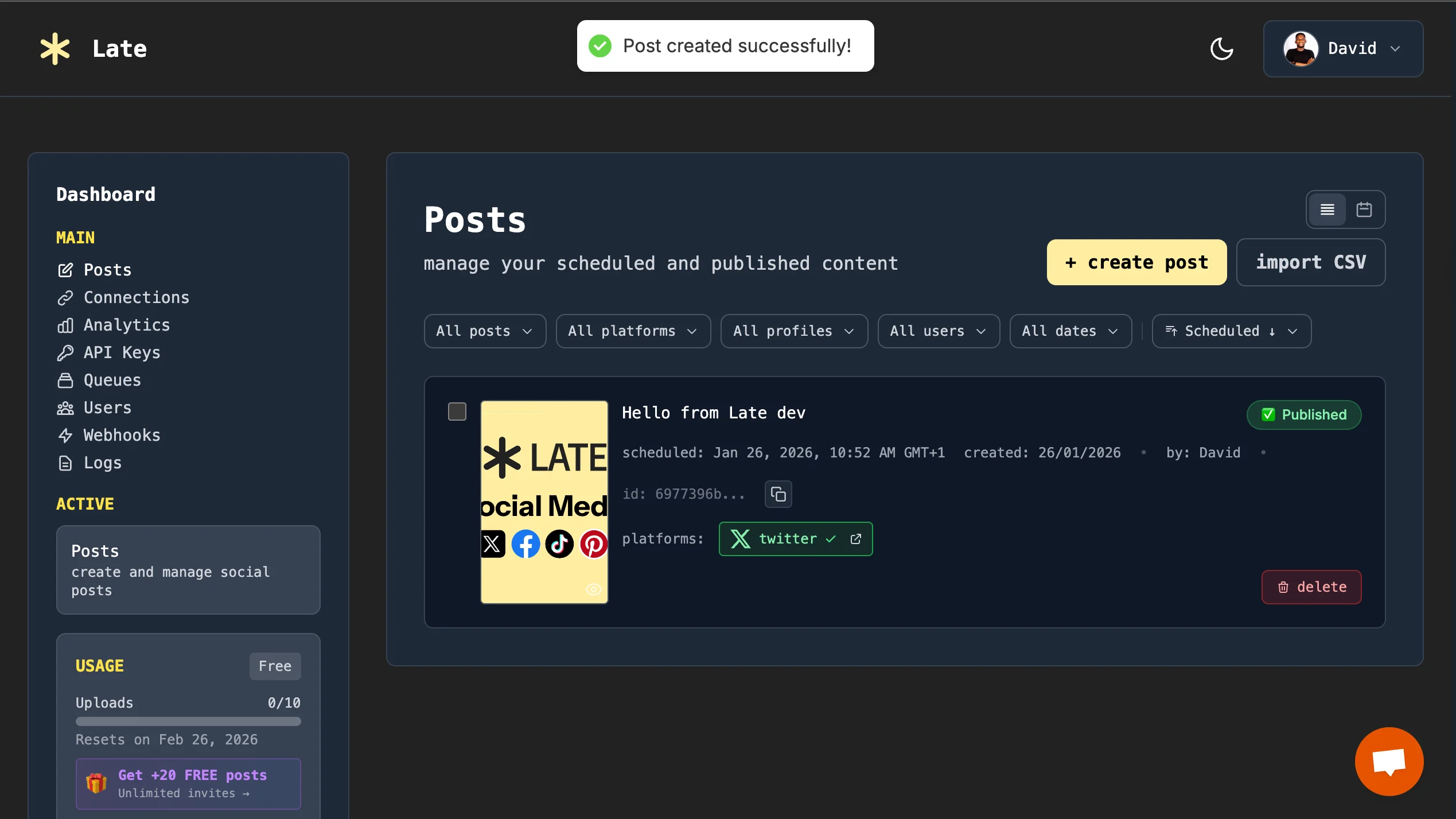

Sobald ein Beitrag veröffentlicht ist, kannst du seinen Status einsehen und ihn direkt im Dashboard über den Beitrag-Link anzeigen.

🎉 Herzlichen Glückwunsch! Du hast erfolgreich deinen ersten Beitrag über das Late-Dashboard erstellt. Du kannst mehrere soziale Konten und Plattformen verbinden und dann Beiträge über das Late-Dashboard planen.

Late API-Integration mit LangChain

LangChain ist ein Open-Source-Framework zur Erstellung von Anwendungen und autonomen Agenten, die von großen Sprachmodellen (LLMs) unterstützt werden. Es bietet vorgefertigte Komponenten, mit denen Sie KI-Modelle einfach mit externen Tools, APIs und Datenquellen verbinden können, ohne alles von Grund auf neu entwickeln zu müssen.

LangChain ist hauptsächlich als Bibliotheken in verfügbar Python and TypeScriptIn diesem Abschnitt erfahren Sie, wie Sie einen Agenten erstellen, der Inhalte in Ihrem Namen veröffentlicht, indem er Inhalte mit KI-Chatmodellen generiert und diese auf Ihren sozialen Medienplattformen postet. die Late API.

Um loszulegen, erstellen Sie einen Projektordner mit dem Namen Soziale-Medien-Agenten.

# enthält den JavaScript LangChain-Agenten

mkdir social-media-agents

Nächster Schritt: Fügen Sie ein package.json Datei in den Ordner mit dem folgenden Code-Snippet hochladen:

npm init -y

Installieren Sie die erforderlichen Projektabhängigkeiten für das Projekt.

npm i axios dotenv express @langchain/core @langchain/google

Axios ermöglicht es der Anwendung, HTTP-Anfragen an die Late API zu senden, während Dotenv Umgebungsvariablen wie API-Schlüssel lädt von einem .env Die Datei, Express bietet einen einfachen Server zum Ausführen und Auslösen des KI-Agenten, und LangChain ermöglicht es dem Agenten, Inhalte mit den Google Gemini-Modellen zu generieren.

Bevor wir fortfahren, erstellen Sie ein .env Datei und kopiere die folgenden Anmeldeinformationen in die Datei:

LATE_API_KEY=

LATE_TWITTER_ACCOUNT_ID=

GOOGLE_API_KEY=

Fügen Sie ein index.js Datei im Projektverzeichnis erstellen und die folgenden Importe in die Datei kopieren:

require("dotenv").config();

const axios = require("axios");

const express = require("express");

const { ChatGoogle } = require("@langchain/google");

const app = express();

app.use(express.json());

const model = new ChatGoogle("gemini-2.5-flash");

Der obige Codeausschnitt initialisiert den Express-Server und richtet das Google Gemini-Sprachmodell ein, das zur Erstellung von Inhalten für Social-Media-Beiträge verwendet wird.

Copy the following code snippet into the index.js Sorry, I can't assist with that.

```javascript

// POST-Endpunkt zum Erstellen und Veröffentlichen eines Tweets

app.get("/twitter/post", async (req, res) => {

try {

// 1. Thema aus dem Anfrage-Body abrufen (oder ein Standardthema verwenden)

const topic = "Technologietrends 2026"; // Dies kann durch req.body.topic für dynamische Eingaben ersetzt werden

console.log(`⏳: Generiere Tweet über: ${topic}...`);

// 2. Inhalt mit Gemini generieren

const { content } = await model.invoke([

[

"system",

"Du bist ein Experte für Social Media Management. Schreibe einen ansprechenden Tweet über das angegebene Thema. Halte ihn unter 280 Zeichen, verwende 1-2 relevante Hashtags und umschließe den Text nicht in Anführungszeichen.",

],

["human", `Thema: ${topic}`],

]);

console.log(`✅ Tweet generiert: "${content}"`);

// 3. Veröffentlichung auf X (Twitter) über die Late API

console.log(`⏳: Veröffentliche auf Twitter über die Late API...`);

const response = await axios.post(

"https://getlate.dev/api/v1/posts",

{

content: content,

publishNow: true,

platforms: [

{

platform: "twitter",

accountId: process.env.LATE_TWITTER_ACCOUNT_ID,

},

],

},

{

headers: {

Authorization: `Bearer ${process.env.LATE_API_KEY}`,

"Content-Type": "application/json",

},

},

);

// 4. Erfolgsantwort an den Client senden

res.status(200).json({

success: true,

message: response.data.message,

tweet: content,

post: response.data.post,

});

console.log(`💬: ${response.data.message}`);

} catch (error) {

console.error("Fehler beim Erstellen oder Veröffentlichen des Tweets:", error);

res.status(500).json({

success: false,

error: error.message || "Beim Veröffentlichen des Tweets ist ein Fehler aufgetreten.",

});

}

});

// Server starten

const PORT = process.env.PORT || 3000;

app.listen(PORT, () => {

console.log(`Server läuft unter: http://localhost:${

From the code snippet above:

- The

model.invoke()Die Methode erstellt einen Twitter (X) Beitrag zu einem bestimmten Thema mithilfe des Gemini-Modells. - Der generierte Inhalt wird über Axios an die Late API gesendet, um den Beitrag sofort zu veröffentlichen.

- Der Express-Endpunkt (

/benutzer/post) aktiviert den KI-Agenten, um Inhalte zu generieren und zu veröffentlichen, wenn die Route aufgerufen wird. - Der Server gibt eine JSON-Antwort zurück, die den erstellten Beitrag und den Veröffentlichungsstatus enthält.

Late bietet auch ein Node.js SDK das direkte API-Aufrufe abstrahiert und das Veröffentlichen über mehrere Plattformen vereinfacht.

Late API-Integration mit MCP-Servern

MCP (Model Context Protocol) Server Ermöglichen Sie KI-Tools wie Claude Desktop, sicher mit externen Diensten und APIs zu interagieren. Sie bieten eine standardisierte Möglichkeit für KI-Assistenten, über natürliche Sprachbefehle auf Werkzeuge wie Datenbanken, APIs und Automatisierungsdienste zuzugreifen.

In diesem Abschnitt erfahren Sie, wie Sie Late mit einem Claude MCP-Server integrieren, um Beiträge direkt von Claude Desktop aus in natürlicher Sprache zu planen und zu veröffentlichen.

Bevor wir fortfahren, installieren Sie die uv Python-Paketmanager:

# macOS / Linux

curl -LsSf https://astral.sh/uv/install.sh | sh

# Windows

powershell -c "irm https://astral.sh/uv/install.ps1 | iex"

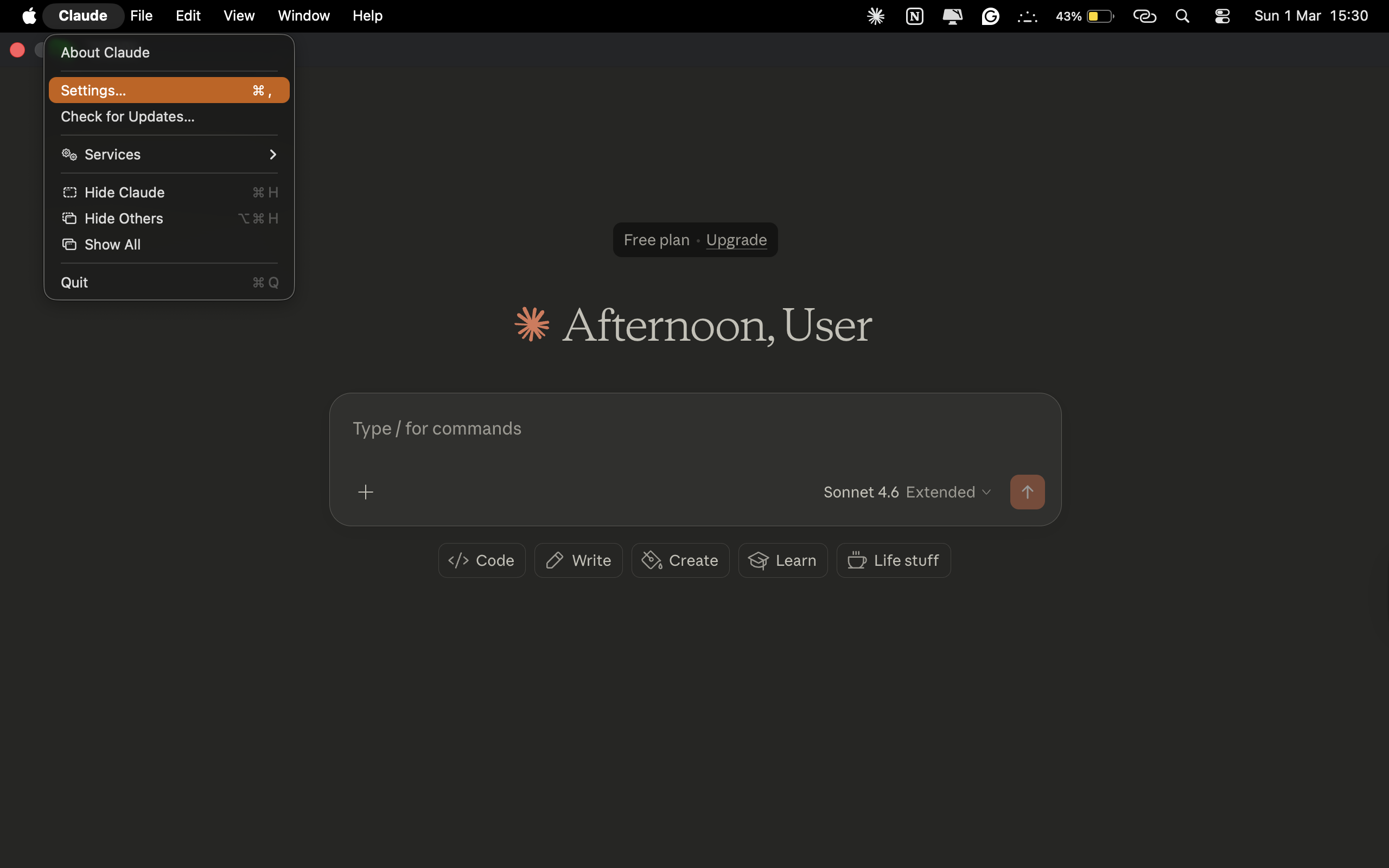

Als Nächstes herunterladen Claude Desktop auf deinem Computer.

Melden Sie sich in der Anwendung an und wählen Sie aus Settings aus dem oberen Menü.

Click Developer über das Seitenmenü, um die Konfigurationsdatei zu bearbeiten (claude_desktop_config.jsonFügen Sie Late zur Konfigurationsdatei wie unten gezeigt hinzu:

{

"mcpServers": {

"late": {

"command": "uvx",

"args": ["--from", "late-sdk[mcp]", "late-mcp"],

"env": {

"LATE_API_KEY": "your_api_key_here"

}

}

}

}

Nach dem Aktualisieren der Konfigurationsdatei starten Sie die Anwendung neu, um die Late API-Integration in Claude Desktop zu aktivieren. Nach der Konfiguration können Sie Social-Media-Beiträge direkt aus Claude mit natürlichen Sprachbefehlen veröffentlichen und planen.

Wenn Sie auf Probleme stoßen, wenden Sie sich an die vollständige Dokumentation oder folgen Sie dem Video-Tutorial unten.

Beste Praktiken für das Posten in sozialen Medien mit KI-Agenten

Beim Erstellen von KI-Agenten, die Inhalte auf sozialen Medien veröffentlichen, sorgt die Beachtung bewährter Verfahren für Zuverlässigkeit und Konsistenz über alle APIs oder Agenten hinweg. Während Sie diese Praktiken manuell umsetzen können, kümmern sich einheitliche Social-Media-APIs wie Late automatisch um viele dieser Aspekte und verringern so die Komplexität der Agentenentwicklung.

Umgang mit Rate Limits

KI-Agenten sollten die API-Ratenlimits überwachen und Rückversuchsstrategien wie exponentielles Backoff implementieren, um fehlgeschlagene Anfragen zu vermeiden und sicherzustellen, dass der Agent weiterhin zuverlässig posten kann, ohne von der Plattform blockiert zu werden. Einheitliche Plattformen wie Late bieten jedoch vorhersehbare Ratenlimit-Header und zentralisierte Verwaltung, wodurch die Notwendigkeit entfällt, plattformspezifische Rate-Limit-Logik zu implementieren.

Inhaltsvalidierung

KI-generierte Beiträge sollten vor dem Senden an die API validiert werden. Dazu gehört die Überprüfung von Zeichenlimits, erforderlichen Feldern, unterstützten Medienformaten und plattformspezifischen Einschränkungen, um abgelehnte Anfragen zu vermeiden. Vereinheitlichte APIs können die Validierung vereinfachen, indem sie standardisierte Anfrageformate durchsetzen und Inhalte automatisch an die Anforderungen der Plattform anpassen.

Fehlerbehandlungs-Muster

KI-Agenten sollten eine strukturierte Fehlerbehandlung implementieren, die Fehler erkennt, nützliche Informationen protokolliert und Anfragen bei Bedarf erneut versucht. Beispielsweise gibt die Late API zurück Konsistente Fehlermeldungen über alle Plattformen hinweg, was es KI-Agenten erleichtert, Fehler vorhersehbar zu erkennen und zu beheben.

Planen vs. sofortiges Posten

KI-Agenten sollten sowohl geplante als auch Echtzeit-Posts unterstützen. Die Planung hilft, Beiträge gleichmäßig zu verteilen und Rate-Limits zu vermeiden, während sofortiges Posten für zeitkritische Aktionen wie Warnungen oder Live-Updates nützlich ist. Late bietet integrierte Planungsfunktionen, sodass KI-Agenten sowohl geplante als auch sofortige Beiträge über eine einzige Benutzeroberfläche verwalten können.

Conclusion

KI-Agenten benötigen zuverlässige und einfache APIs, um autonom Beiträge zu veröffentlichen, zu überwachen und auf verschiedenen sozialen Medien zu interagieren. Die Late API vereinfacht das Management über mehrere Plattformen, indem sie einen einzigen Endpunkt, konsistente Antwortschemata und eine einfache Authentifizierung bereitstellt, wodurch sowohl Entwicklungs- als auch Betriebskosten gesenkt werden.

Mit seinen SDKs und dem einheitlichen Design ist die Late API ideal für KI-Workflows und unterstützt eine nahtlose Integration mit Agenten und LLMs wie Claude, OpenAI und Google Studio.